Empresas de distintos sectores están empleando herramientas de inteligencia artificial para estimar el salario mínimo que un candidato o empleado aceptaría antes de que ese trabajador abra la boca en ninguna negociación. El mecanismo, que investigadores y organizaciones laborales han bautizado como «salario de vigilancia», se apoya en datos de comportamiento, historial financiero y señales de vulnerabilidad económica para fijar una remuneración individualizada. Un informe del Washington Center for Equitable Growth, que analizó a 500 empresas de IA dedicadas a la gestión laboral, identificó 20 proveedores cuyos productos presentan un riesgo elevado de generar discriminación salarial algorítmica, 16 de los cuales integran sus herramientas directamente con plataformas de nómina o gestión de personal.

Cómo los algoritmos calculan tu precio antes de que tú lo fijes

El sistema funciona rastreando información accesible públicamente o extraída de redes sociales: con qué frecuencia acepta turnos un trabajador, a qué velocidad responde a ofertas de trabajo, qué cobró en empleos anteriores o si mantiene deudas en tarjeta de crédito o préstamos activos. Nina DiSalvo, directora de políticas del grupo laboral Towards Justice, describe el proceso con precisión: «Algunos sistemas utilizan señales asociadas a la vulnerabilidad financiera, como datos sobre si un posible empleado ha solicitado un préstamo rápido o tiene un saldo elevado en su tarjeta de crédito, para inferir el salario mínimo que un candidato podría aceptar». El resultado práctico es que dos personas realizando exactamente el mismo trabajo pueden cobrar cantidades distintas sin saberlo y sin mecanismo alguno para reclamar.

El informe Prohibición de precios y salarios de vigilancia, elaborado por varias organizaciones laborales estadounidenses, subraya que la monitorización no se detiene en el momento de la contratación. Una vez dentro de la empresa, el algoritmo sigue observando: si el empleado acepta turnos urgentes, si trabaja más horas de lo habitual o si su situación financiera empeora. Cada una de esas señales es interpretada como una señal de dependencia del puesto, lo que puede traducirse en ofertas económicas más bajas. Cuanto mayor es la necesidad, menor puede ser la oferta.

Una caja negra que ni sindicatos ni reguladores pueden auditar

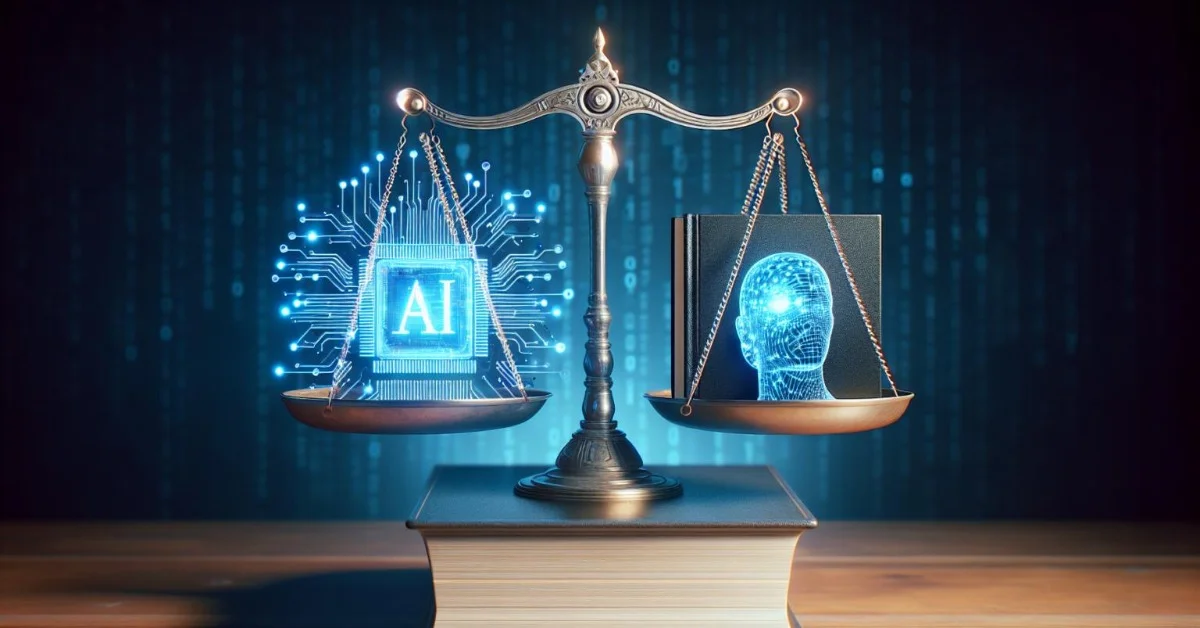

La opacidad es, según los investigadores, parte estructural del diseño. Los algoritmos que determinan la remuneración no están disponibles para empleados, representantes sindicales ni organismos reguladores. Joe Hudicka, autor del libro La revolución de los ecosistemas de IA, lo sintetiza en declaraciones recogidas por MarketWatch: «Conocemos el concepto del techo de cristal. Pero al menos en ese concepto tenemos cierta visibilidad a través de él. Este techo de vigilancia salarial es de hierro». Un estudio del Cornell University's Worker Institute detectó que el 42% de los trabajadores de plataformas digitales en Nueva York declararon haber cobrado menos de lo acordado, sin disponer de mecanismos claros para impugnarlo.

La investigadora Veena Dubal, de la Universidad de California, lleva años documentando casos concretos en plataformas de reparto y transporte: desde conductores a los que se deja de asignar servicios justo antes de que alcancen su objetivo de productividad, hasta ajustes de tarifa aplicados de forma individual e invisible. El fenómeno, advierte el Washington Center for Equitable Growth, ya no se limita a la llamada gig economy, sino que se extiende a la sanidad, la atención al cliente, la logística y el comercio minorista.

Las respuestas legislativas que empiezan a tomar forma

Los legisladores, por ahora de forma incipiente, comienzan a reaccionar. En Estados Unidos, Colorado tramita el proyecto de ley HB26-1210, una de las primeras iniciativas en el país que busca regular de manera específica el uso de herramientas algorítmicas en la fijación de salarios a partir de datos personales. En España, la llamada Ley Rider introdujo en su momento una modificación al artículo 64.4 del Estatuto de los Trabajadores que obliga a dar acceso al algoritmo que gestiona jornadas y asignación de pedidos en plataformas de reparto. A escala europea, la normativa sobre transparencia retributiva apunta en la misma dirección al limitar la disparidad salarial entre personas que realizan un trabajo equivalente.

La convergencia de estas iniciativas regulatorias sugiere que el debate sobre el control algorítmico de los salarios ha salido del ámbito académico para instalarse en las agendas legislativas. La cuestión pendiente es si las leyes avanzarán con la suficiente rapidez como para que los trabajadores afectados puedan auditar los sistemas que ya están tomando decisiones sobre su remuneración.